Thời gian gần đây, Bộ Công an liên tiếp phát đi cảnh báo về một hình thức lừa đảo công nghệ cao mới, vô cùng tinh vi và nguy hiểm. Đáng chú ý, hình thức này sử dụng trí tuệ nhân tạo (AI), đặc biệt là kỹ thuật deepfake để cắt ghép hình ảnh, video nhạy cảm với mục đích đe dọa, tống tiền. Bất kỳ ai – từ người dân bình thường đến những người có địa vị xã hội cao – đều có thể trở thành mục tiêu của các đối tượng lừa đảo.

Deepfake – Công cụ lừa đảo nguy hiểm thời 4.0

Công nghệ deepfake là kỹ thuật ứng dụng trí tuệ nhân tạo (AI) để ghép mặt người thật vào các đoạn video, hình ảnh có sẵn, tạo ra những nội dung giả mạo nhưng vô cùng chân thực. Công nghệ này từng được ứng dụng trong lĩnh vực điện ảnh và giải trí, nhưng hiện đang bị các đối tượng xấu lợi dụng để thực hiện các hành vi phạm pháp.

Theo thông tin từ Bộ Công an, các nhóm lừa đảo sử dụng công nghệ deepfake để gây sức ép tâm lý, khủng bố tinh thần nạn nhân, buộc họ phải chuyển tiền để “giải quyết trong im lặng”. Đáng sợ hơn, hành vi này ngày càng tinh vi, khó phát hiện, và có thể xảy ra với bất kỳ ai, không phân biệt tuổi tác, ngành nghề hay vị trí xã hội.

Thủ đoạn lừa đảo deepfake: Tinh vi từng bước

Bộ Công an đã mô tả chi tiết quy trình lừa đảo bằng công nghệ deepfake, bao gồm 3 bước chính:

1. Thu thập thông tin cá nhân

Các đối tượng khai thác hình ảnh, video, số điện thoại và thông tin cá nhân của nạn nhân từ mạng xã hội hoặc các nguồn công khai trên Internet. Những người có thói quen chia sẻ nhiều thông tin cá nhân, hình ảnh trên Facebook, Zalo, TikTok… là mục tiêu hàng đầu của bọn chúng.

2. Tạo video giả bằng deepfake

Sử dụng công nghệ AI, nhóm tội phạm sẽ cắt ghép khuôn mặt của nạn nhân vào các video nhạy cảm, đồi trụy. Nhờ kỹ thuật deepfake ngày càng tinh vi, những video giả này giống thật đến mức người xem khó phân biệt được đâu là thật, đâu là giả.

3. Tống tiền nạn nhân

Sau khi tạo được sản phẩm giả mạo, bọn tội phạm sẽ gửi video đến nạn nhân kèm lời đe dọa. Chúng yêu cầu chuyển tiền vào tài khoản ngân hàng, ví điện tử hoặc qua các hình thức chuyển tiền ẩn danh, với số tiền dao động từ vài triệu đến hàng tỷ đồng. Đổi lại, chúng hứa sẽ “xóa clip”, “giải quyết trong êm đẹp” và không phát tán nội dung lên mạng.

Đối tượng nhắm đến: Từ người nổi tiếng đến người bình thường

Bộ Công an cho biết, hiện nay các nhóm tội phạm không chỉ nhắm vào những người nổi tiếng, có địa vị xã hội cao như lãnh đạo các sở, ban, ngành, giới doanh nhân, mà còn mở rộng sang cả người dân bình thường. Chỉ cần bạn có ảnh chân dung rõ nét, thông tin cá nhân bị lộ – bạn đã có thể trở thành mục tiêu tiếp theo.

Mức độ ảnh hưởng của các vụ lừa đảo bằng deepfake không chỉ dừng lại ở thiệt hại kinh tế, mà còn ảnh hưởng nghiêm trọng đến danh dự, uy tín, tâm lý của nạn nhân, gây hậu quả lâu dài trong đời sống cá nhân và xã hội.

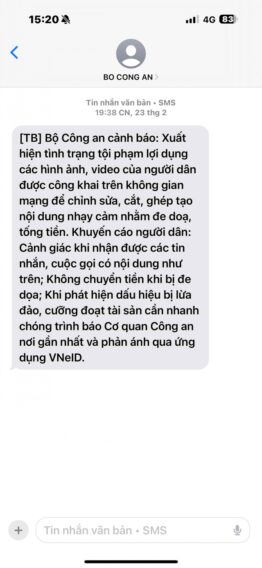

Bộ Công an đưa ra khuyến cáo chính thức

Trước tình trạng này, Bộ Công an khuyến cáo người dân cần hết sức cảnh giác và thực hiện các biện pháp bảo vệ thông tin cá nhân như sau:

✅ Không chia sẻ quá nhiều thông tin cá nhân

Hạn chế đăng ảnh chân dung, video, thông tin cá nhân như số điện thoại, địa chỉ nhà riêng, nơi làm việc… lên mạng xã hội. Cài đặt chế độ bảo mật cao cho tài khoản cá nhân.

✅ Cảnh giác với các tin nhắn, cuộc gọi đe dọa

Nếu nhận được những tin nhắn hoặc cuộc gọi có nội dung đe dọa, yêu cầu chuyển tiền để “xử lý hình ảnh nhạy cảm”, tuyệt đối không làm theo, không chuyển tiền.

✅ Nhanh chóng trình báo công an

Trong trường hợp nghi ngờ bị lừa đảo, hãy báo ngay với cơ quan Công an gần nhất hoặc phản ánh qua ứng dụng VNeID, không nên giữ im lặng hoặc tự giải quyết, vì điều đó có thể khiến tình hình thêm nghiêm trọng.

✅ Nâng cao nhận thức, cảnh giác trong cộng đồng

Chia sẻ thông tin cảnh báo đến người thân, bạn bè, đặc biệt là những người lớn tuổi, không rành công nghệ – nhóm dễ trở thành nạn nhân vì không nhận thức được mức độ tinh vi của hình thức lừa đảo này.

Vì sao ai cũng có thể là nạn nhân?

Khác với các chiêu trò lừa đảo trước đây chỉ nhắm vào những người nhẹ dạ cả tin, lừa đảo công nghệ cao bằng deepfake nhắm vào cả những người cẩn trọng nhất. Bởi các video, hình ảnh được tạo ra có độ chân thực cao, gây khủng hoảng tâm lý ngay lập tức cho nạn nhân.

Ngoài ra, việc các đối tượng tội phạm sử dụng tài khoản ngân hàng ảo, ví điện tử giả danh khiến việc truy vết và xử lý rất phức tạp, đòi hỏi sự phối hợp của nhiều cơ quan chức năng và các đơn vị công nghệ.

Lừa đảo bằng deepfake – công nghệ AI giả mạo hình ảnh, video – là hình thức tội phạm nguy hiểm mới, đang đe dọa đến mọi đối tượng trong xã hội. Mỗi người dân cần nâng cao cảnh giác, bảo vệ thông tin cá nhân và hợp tác chặt chẽ với cơ quan chức năng khi phát hiện dấu hiệu bị tống tiền, lừa đảo.

Hãy luôn nhớ rằng: “Cẩn thận trên không gian mạng cũng chính là bảo vệ chính mình và người thân.”